Mengikuti perkembangan industri yang bergerak cepat seperti AI adalah hal yang sulit. Jadi hingga AI dapat melakukannya untuk Anda, berikut adalah ringkasan praktis dari kisah-kisah terkini di dunia pembelajaran mesin, bersama dengan penelitian dan eksperimen penting yang tidak kami bahas sendiri.

Minggu ini di AI, siklus berita akhirnya (akhirnya!) sedikit mereda menjelang musim liburan. Namun bukan berarti tidak ada hal yang bisa ditulis, hal ini merupakan berkah sekaligus kutukan bagi reporter yang kurang tidur ini.

Judul khusus dari AP menarik perhatian saya pagi ini: “Pembuat gambar AI sedang dilatih untuk memotret anak-anak secara eksplisit.” Inti ceritanya adalah, LAION, kumpulan data yang digunakan untuk melatih banyak generator gambar AI open source dan komersial yang populer, termasuk Difusi Stabil dan Gambar, berisi ribuan gambar dugaan pelecehan seksual terhadap anak. Sebuah kelompok pengawas yang berbasis di Stanford, Stanford Internet Observatory, bekerja dengan badan amal anti-penyalahgunaan untuk mengidentifikasi materi ilegal dan melaporkan tautannya ke penegak hukum.

Kini, LAION, sebuah organisasi nirlaba, telah menghapus data pelatihannya dan berjanji untuk menghapus materi yang melanggar sebelum menerbitkannya kembali. Namun kejadian ini menunjukkan betapa sedikitnya perhatian yang diberikan pada produk AI generatif seiring dengan meningkatnya tekanan persaingan.

Berkat berkembangnya alat pembuatan model AI tanpa kode, melatih AI generatif pada kumpulan data apa pun menjadi sangat mudah. Hal ini merupakan keuntungan bagi perusahaan rintisan dan raksasa teknologi untuk meluncurkan model seperti itu. Namun, dengan semakin rendahnya hambatan masuk, muncullah godaan untuk mengesampingkan etika demi mempercepat jalur menuju pasar.

Etika itu sulit – tidak dapat disangkal. Menyisir ribuan gambar bermasalah di LAION, misalnya minggu ini, tidak akan terjadi dalam semalam. Idealnya, mengembangkan AI secara etis melibatkan kerja sama dengan semua pemangku kepentingan terkait, termasuk organisasi yang mewakili kelompok yang sering terpinggirkan dan terkena dampak buruk sistem AI.

Industri ini penuh dengan contoh keputusan rilis AI yang dibuat dengan mempertimbangkan pemegang saham, bukan ahli etika. Ambil contoh Bing Chat (sekarang Microsoft Copilot), chatbot Microsoft yang didukung AI di Bing, yang mana meluncurkan membandingkan seorang jurnalis dengan Hitler dan menghina penampilan mereka. Hingga bulan Oktober, ChatGPT dan Bard, pesaing ChatGPT Google, masih ada memberi nasihat medis yang ketinggalan jaman dan rasis. Dan versi terbaru dari generator gambar OpenAI DALL-E ditampilkan bukti dari Anglosentrisme.

Cukuplah untuk mengatakan bahwa kerugian terjadi dalam upaya mengejar keunggulan AI – atau setidaknya gagasan Wall Street tentang keunggulan AI. Mungkin dengan disahkannya peraturan AI di UE, yang mengancam akan dikenakan denda jika tidak mematuhi batasan AI tertentu, masih ada harapan. Namun jalan di depannya memang masih panjang.

Berikut adalah beberapa kisah AI lainnya yang perlu diperhatikan dalam beberapa hari terakhir:

Prediksi AI pada tahun 2024: Devin memaparkan prediksinya mengenai AI pada tahun 2024, antara lain membahas bagaimana AI dapat berdampak pada pemilu pendahuluan AS dan apa yang akan terjadi selanjutnya pada OpenAI.

Melawan pseudantropi: Devin juga menulis menyarankan agar AI dilarang meniru perilaku manusia.

Microsoft Copilot mendapatkan kreasi musik: Copilot, chatbot Microsoft yang didukung AI, kini dapat membuat lagu berkat integrasi dengan aplikasi musik GenAI Suno.

Pengenalan wajah di Rite Aid: Rite Aid telah dilarang menggunakan teknologi pengenalan wajah selama lima tahun setelah Komisi Perdagangan Federal menemukan bahwa “penggunaan sistem pengawasan wajah yang sembrono” oleh raksasa toko obat AS tersebut telah mempermalukan pelanggan dan membahayakan “informasi sensitif” mereka.

UE menawarkan sumber daya komputasi: UE memperluas rencananya, yang awalnya diumumkan pada bulan September dan dimulai bulan lalu, untuk mendukung startup AI dalam negeri dengan memberi mereka akses terhadap kekuatan pemrosesan untuk pelatihan model superkomputer di blok tersebut.

OpenAI memberikan kekuatan baru kepada dewan: OpenAI memperluas proses keamanan internalnya untuk menangkis ancaman AI yang berbahaya. Sebuah “kelompok penasihat keselamatan” baru akan duduk di atas tim teknis dan membuat rekomendasi kepada pimpinan, dan dewan telah diberikan hak veto.

Tanya Jawab dengan Ken Goldberg dari UC Berkeley: Untuk buletin reguler Actuator, Brian duduk bersama Ken Goldberg, seorang profesor di UC Berkeley, seorang pendiri startup dan ahli robotika ulung, untuk membahas robot humanoid dan tren yang lebih luas dalam industri robotika.

CIO melakukannya dengan lambat dengan gen AI: Ron menulis bahwa, meskipun CIO berada di bawah tekanan untuk memberikan pengalaman seperti yang dilihat orang-orang saat mereka bermain dengan ChatGPT online, sebagian besar CIO mengambil pendekatan yang disengaja dan hati-hati dalam mengadopsi teknologi tersebut untuk perusahaan.

Penerbit berita menuntut Google atas AI: Gugatan class action yang diajukan oleh beberapa penerbit berita menuduh Google melakukan “siphon[ing] mematikan” konten berita melalui cara anti persaingan, sebagian melalui teknologi AI seperti Google Search Generative Experience (SGE) dan Bard chatbot.

Tinta OpenAI berhubungan dengan Axel Springer: Berbicara tentang penerbit, OpenAI menandatangani kesepakatan dengan Axel Springer, pemilik publikasi yang berbasis di Berlin termasuk Business Insider dan Politico, untuk melatih model AI generatifnya pada konten penerbit dan menambahkan artikel terbaru yang diterbitkan Axel Springer ke ChatGPT.

Google menghadirkan Gemini ke lebih banyak tempat: Google mengintegrasikan model Gemini dengan lebih banyak produk dan layanannya, termasuk platform pengembang AI yang dikelola Vertex AI dan AI Studio, alat perusahaan untuk membuat chatbot berbasis AI dan pengalaman serupa lainnya.

Lebih banyak pembelajaran mesin

Tentu saja ini adalah penelitian yang paling liar (dan paling mudah untuk disalahartikan) dalam satu atau dua minggu terakhir kehidupan2vec, sebuah penelitian di Denmark yang menggunakan titik data yang tak terhitung jumlahnya dalam kehidupan seseorang untuk memprediksi seperti apa seseorang dan kapan mereka akan meninggal. Dengan kasar!

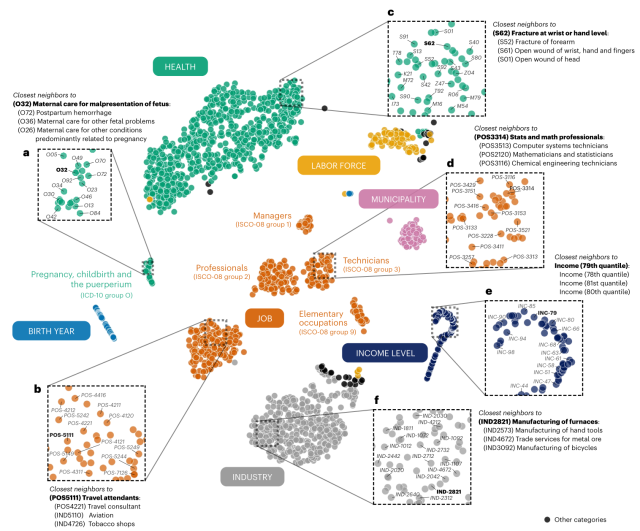

Visualisasi pemetaan life2vec terhadap berbagai konsep dan peristiwa kehidupan yang relevan.

Penelitian ini tidak mengklaim keakuratan ramalan (katakanlah tiga kali lebih cepat) namun lebih bertujuan untuk menunjukkan bahwa jika hidup kita adalah gabungan dari pengalaman kita, jalur tersebut dapat diekstrapolasi menggunakan teknik pembelajaran mesin saat ini. Antara pola asuh, pendidikan, pekerjaan, kesehatan, hobi, dan metrik lainnya, seseorang dapat memprediksi dengan masuk akal bukan hanya apakah seseorang itu, katakanlah, introvert atau ekstrover, namun juga bagaimana faktor-faktor ini dapat memengaruhi harapan hidup. Kami belum berada pada tingkat “precrime” di sini, namun Anda dapat yakin bahwa perusahaan asuransi tidak sabar untuk melisensikan pekerjaan ini.

Klaim besar lainnya dibuat oleh ilmuwan CMU yang menciptakan sistem yang disebut Coscientist, asisten peneliti berbasis LLM yang dapat melakukan banyak pekerjaan laboratorium yang membosankan secara mandiri. Saat ini model tersebut terbatas pada bidang kimia tertentu, tetapi seperti halnya ilmuwan, model seperti ini juga akan menjadi spesialis.

Peneliti utama Gabe Gomes mengatakan kepada Nature: “Saat saya melihat kecerdasan non-organik mampu secara mandiri merencanakan, merancang, dan melaksanakan reaksi kimia yang ditemukan oleh manusia, sungguh menakjubkan. Itu adalah momen 'sialan'.” Pada dasarnya ia menggunakan LLM seperti GPT-4, yang disesuaikan dengan dokumen kimia, untuk mengidentifikasi reaksi umum, reagen, dan prosedur serta melaksanakannya. Jadi, Anda tidak perlu meminta teknisi laboratorium untuk mensintesis 4 kumpulan katalis — AI dapat melakukannya, dan Anda bahkan tidak perlu memegang tangannya.

Peneliti AI Google juga mengalami minggu yang penting, menyelami beberapa domain terdepan yang menarik. Pencarian Menyenangkan mungkin terdengar seperti Google untuk anak-anak, namun sebenarnya ini adalah kependekan dari pencarian fungsi, yang seperti Coscientist mampu membuat dan membantu membuat penemuan matematika. Menariknya, untuk mencegah halusinasi, ini (seperti yang lainnya baru-baru ini) menggunakan sepasang model AI yang mirip dengan arsitektur GAN “lama”. Yang satu berteori, yang lain menilai.

Meskipun FunSearch tidak akan membuat penemuan baru yang inovatif, FunSearch dapat mengambil apa yang ada di luar sana dan mengasah atau menerapkannya kembali di tempat baru, sehingga fungsi yang digunakan oleh satu domain tetapi tidak disadari oleh domain lain mungkin digunakan untuk meningkatkan standar industri algoritma.

Gaya Jatuhkan adalah alat yang berguna bagi orang yang ingin meniru gaya tertentu melalui citra generatif. Masalahnya (seperti yang dilihat oleh peneliti) adalah jika Anda memikirkan suatu gaya (katakanlah “pastel”) dan mendeskripsikannya, model tersebut akan memiliki terlalu banyak sub-gaya “pastel” yang dapat digunakan, sehingga hasilnya akan seperti ini. tidak dapat diprediksi. StyleDrop memungkinkan Anda memberikan contoh gaya yang Anda pikirkan, dan model akan mendasarkan kerjanya pada hal tersebut — pada dasarnya ini merupakan penyesuaian yang sangat efisien.

Kredit Gambar: Google

Postingan blog dan makalahnya menunjukkan bahwa ini cukup kuat, menerapkan gaya dari gambar apa pun, apakah itu foto, lukisan, lanskap kota, atau potret kucing, ke jenis gambar lainnya, bahkan alfabet (terkenal sulit karena alasan tertentu).

Google juga bergerak dalam permainan video generatif dengan VideoPoet, yang menggunakan basis LLM (seperti yang lainnya saat ini… apa lagi yang akan Anda gunakan?) untuk melakukan banyak tugas video, mengubah teks atau gambar menjadi video, memperluas atau menata video yang sudah ada, dan sebagainya. Tantangannya di sini, seperti yang dijelaskan dalam setiap proyek, bukan sekadar membuat serangkaian gambar yang berhubungan satu sama lain, namun menjadikannya koheren dalam jangka waktu yang lebih lama (seperti lebih dari satu detik) dan dengan pergerakan serta perubahan yang besar.

Kredit Gambar: Google

Penyair Video sepertinya menggerakkan bola ke depan, meskipun seperti yang Anda lihat, hasilnya masih cukup aneh. Namun begitulah perkembangannya: mula-mula tidak memadai, lalu aneh, lalu luar biasa. Agaknya mereka akan pergi secara luar biasa pada suatu saat, tetapi belum ada yang benar-benar sampai di sana.

Dari sisi praktis, peneliti Swiss telah menerapkan model AI pada pengukuran salju. Biasanya seseorang akan bergantung pada stasiun cuaca, namun hal ini bisa saja terjadi dan kita memiliki semua data satelit yang bagus, bukan? Benar. Jadi tim ETHZ mengambil citra satelit publik dari konstelasi Sentinel-2, namun seperti yang dikatakan oleh pemimpin Konrad Schindler, “Hanya melihat bagian putih pada citra satelit tidak langsung memberi tahu kita seberapa dalam saljunya.”

Jadi mereka memasukkan data medan untuk seluruh negara dari Kantor Topografi Federal (seperti USGS kami) dan melatih sistem untuk memperkirakan tidak hanya berdasarkan potongan putih dalam citra tetapi juga data kebenaran dasar dan kecenderungan seperti pola lelehan. Teknologi yang dihasilkan dikomersialkan oleh ExoLabs, yang akan saya hubungi untuk mempelajari lebih lanjut.

Sebuah kata peringatan dari StanfordNamun demikian — meskipun penerapan seperti di atas sangat ampuh, perhatikan bahwa tidak ada satupun yang melibatkan banyak bias manusia. Ketika berbicara tentang kesehatan, hal ini tiba-tiba menjadi masalah besar, dan kesehatan adalah tempat di mana banyak alat AI sedang diuji. Peneliti Stanford menunjukkan bahwa model AI menyebarkan “kiasan ras medis kuno”. GPT-4 tidak mengetahui apakah sesuatu itu benar atau tidak, sehingga dapat dan memang meniru klaim lama yang tidak terbukti mengenai suatu kelompok, seperti bahwa orang kulit hitam memiliki kapasitas paru-paru yang lebih rendah. Tidak! Tetap waspada jika Anda bekerja dengan model AI apa pun di bidang kesehatan dan pengobatan.

Terakhir, inilah cerita pendek yang ditulis oleh Bard dengan naskah pengambilan gambar dan petunjuknya, yang dirender oleh VideoPoet. Hati-hati, Pixar!